OpenAI o3-mini ist ein kleines Reasoning Modell aus der o Serie und zielt auf starke Logik bei moderaten Kosten und hoher Geschwindigkeit. In diesem Guide erfahren Sie, was o3 mini ist, wann es sich lohnt und wie es sich im Vergleich zu GPT 4o und o1 mini einordnet. Dazu erhalten Sie eine praxisnahe Einordnung zu Funktionen wie Structured Outputs und Function Calling sowie konkrete Use Cases fuer Coding und STEM und ein kompaktes Benutzerhandbuch fuer den schnellen Start.

Was ist OpenAI o3 mini?

Definition von o3-mini

o3 mini ist ein kleines Reasoning Modell von OpenAI. Der Fokus liegt auf logischem Schlussfolgern und kosteneffizienter Problemlosung, vor allem bei Aufgaben in Mathe Naturwissenschaften und Programmierung. OpenAI positioniert o3 mini als besonders kosten effizient innerhalb der Reasoning Serie und gleichzeitig als Modell, das bei aehnlichen Kosten und Latenz Zielen wie o1 mini eine hohe Intelligenz liefert.

Wann man sich fuer o3 mini

o3 mini lohnt sich besonders, wenn Sie

- Coding Aufgaben haben, die mehr als reines Autocomplete brauchen (Debugging, Refactoring, Tests, Code Review)

- STEM Probleme loesen (Formeln, Herleitungen, Algorithmik, strukturierte Analysen)

- Workflows bauen, in denen das Modell zuverlaessig strukturierte Ergebnisse liefern muss (z B JSON) und Tools aufrufen soll

Wenn Sie hingegen stark multimodal arbeiten (z B Bilder oder visuelle Inputs) oder maximal fluessige Dialoge fuer Marketing Copywriting und Brand Voice im Vordergrund stehen, kann GPT 4o in vielen Faellen die passendere Wahl sein, weil es als multimodales Modell konzipiert ist. (Die konkrete Modellwahl haengt von Ihrem Setup ab, siehe Vergleichskapitel.)

o3 mini Funktionen und technische Daten

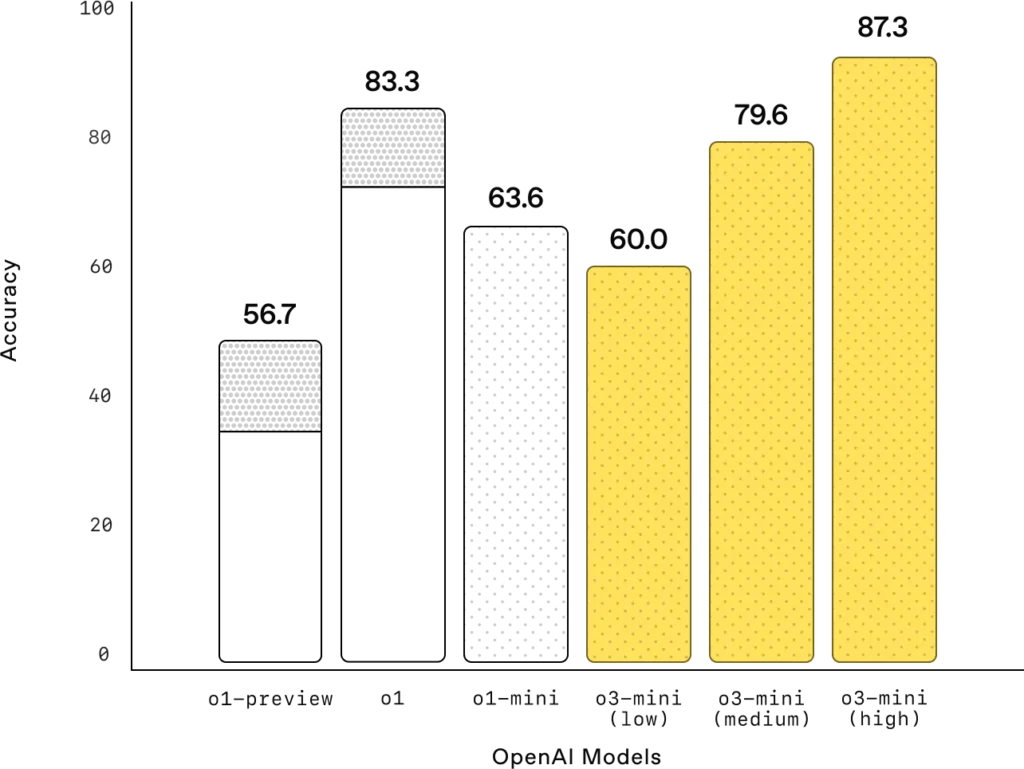

Argumentation Aufwand

Ein zentraler Hebel bei o3 mini ist der Reasoning bzw Argumentationsaufwand. Vereinfacht gesagt steuert er, wie viel “Denkbudget” das Modell in die Loesung steckt:

- niedrig: schnell und guenstig fuer einfache Logik, kurze Checks, schnelle Code Hinweise

- mittel: guter Standard fuer die meisten technischen Aufgaben

- hoch: wenn die Aufgabe komplex ist (verschachtelte Logik, anspruchsvolle Beweise, schwierige Debugging Faelle)

Kontextfenster und Ausgabetoken

Bei der Auswahl eines Modells in der Praxis sind Kontextfenster und maximale Ausgabe entscheidend:

- Ein grosses Kontextfenster hilft, wenn Sie lange Spezifikationen, viele Logfiles oder umfangreiche Dokumente im Prompt verarbeiten (RAG, Long Form Analysen).

- Eine hohe maximale Ausgabe ist wichtig fuer lange Loesungen, ausfuehrliche Reports oder Code Generierung in groesseren Bloecken.

In den OpenAI Modelldaten wird o3 mini als Modell mit 200K Context Window gefuehrt. Das ist gerade fuer Entwickler und Produktteams relevant, die mit langen Inputs arbeiten.

Structured Outputs Tool Calling Batch API

Wenn Sie im deutschen Markt nach “o3 mini fuer Entwickler” suchen, geht es fast immer um drei Themen:

- Structured Outputs: Das Modell kann kontrollierter strukturierte Formate liefern (z B JSON), was Integrationen stabiler macht.

- Function Calling: Das Modell kann Tools gezielt aufrufen, etwa Datenbankabfragen, interne APIs, CRM Aktionen oder Rechenfunktionen.

- Batch API: Fuer grosse Mengen an Requests (z B Auswertung vieler Texte) kann Batch Verarbeitung Kosten und Prozess verbessern.

Diese Features sind explizit fuer o3 mini angegeben und sind der Hauptgrund, warum o3 mini in echten Produktivsystemen attraktiv ist.

Wissensgrenze und Einschraenkungen

Jedes Modell hat Grenzen. Fuer o3 mini sollten Sie in Ihrem Content klar benennen:

- Es ist ein Reasoning Textfokus Modell. Wenn Ihr Use Case stark visuell ist, brauchen Sie ggf ein anderes Modell oder einen Tool Mix.

- Bei hochkritischen Entscheidungen (Recht Medizin Finanzen) sind Human Review und Validierung Pflicht.

- In Developer Setups sind Guardrails wichtig: Input Validierung, Output Schema Checks, Monitoring, Evals.

>> Siehe auch: ChatGPT 3.5 – Funktionen, Vorteile und kostenlose Nutzung

Vergleich von O3-mini mit o1-mini

Mathe & Programmierung

Sowohl o1-mini als auch o3-mini gehören zur Kategorie der Reasoning-Modelle, optimiert für STEM – besonders Mathematik und Coding. OpenAI hat o1-mini ursprünglich als „cost-efficient“ Reasoning-Modell vorgestellt, das in Evaluations rund um Mathe- und Code-Aufgaben stark abschneidet.

Der entscheidende Unterschied für technische Nutzer:innen: o3-mini ist die neuere Version – und OpenAI empfiehlt o3-mini, weil es bei gleicher Latenz und gleichem Preis im Vergleich zu o1-mini eine „higher intelligence“ bietet.

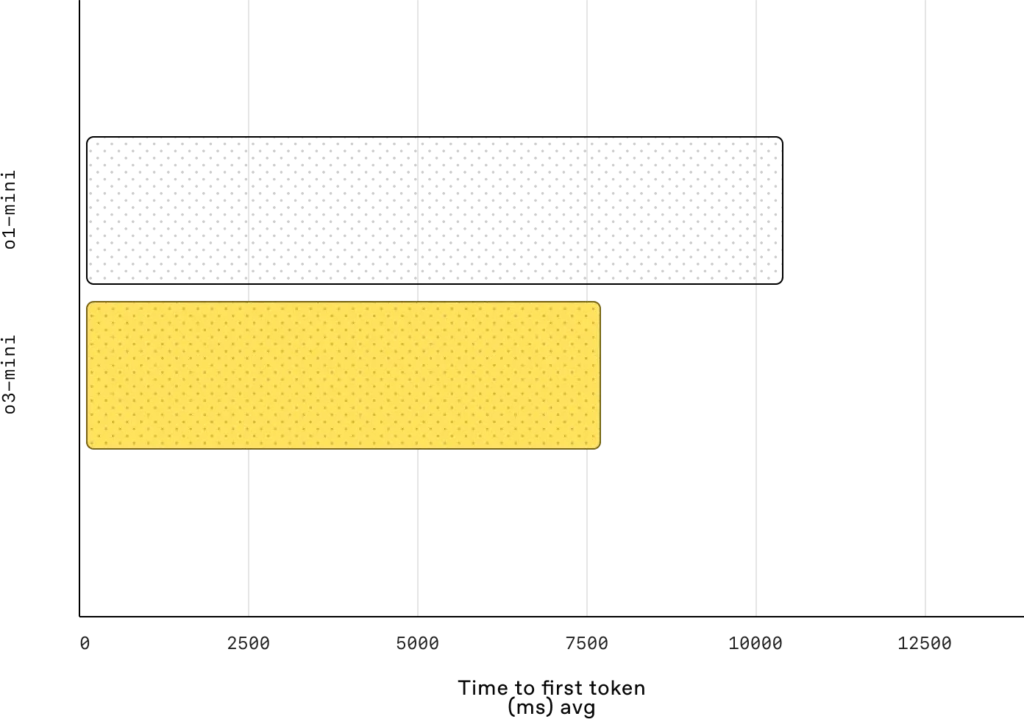

Geschwindigkeit & Effizienz

Aus Sicht der Implementierungseffizienz hat o3-mini häufig Vorteile in zwei Bereichen:

1) Kosten-/Leistungs-Verhältnis (Cost-Performance)

o3-mini wird oft als sinnvolle Option genannt, wenn du gutes Reasoning brauchst, aber Kosten optimieren willst (passend zur Keyword-Gruppe „o3-mini Preis / API Kosten“). Auch auf der o1-mini-Modellseite betont OpenAI, dass o3-mini bei gleichem Preis und gleicher Latenz intelligenter ist.

2) Operative Effizienz (Ops Efficiency)

o3-mini unterstützt produktionsnahe Features wie Structured Outputs, Function Calling und Batch API. Das reduziert Formatfehler in Outputs, erhöht die Automatisierbarkeit und senkt dadurch häufig die realen Betriebskosten.

Sicherheit

Aus „Security“-Perspektive gilt: Entscheidend ist nicht nur das Modell, sondern wie du es integrierst.

Gemeinsamkeiten (o1-mini & o3-mini):

- Beides sind proprietäre Modelle, typischerweise genutzt über API oder Plattformen wie OpenAI / Azure.

- Hauptrisiken im Unternehmen: Data Leakage, Prompt Injection, Tool Misuse und Preisgabe sensibler Informationen in Logs.

Ob du o1-mini oder o3-mini wählst, entscheidet nicht automatisch über Sicherheit – den Unterschied macht deine Governance + Guardrails in der Integration.

Mehrsprachigkeit

Für den DACH-Kontext fällt „Multilingual“ typischerweise in drei Szenarien:

- Sehr gutes Lesen/Schreiben auf Deutsch (Technik-Dokus, Tickets, interne E-Mails)

- Arbeiten mit Code + mehrsprachigen Kommentaren

- Customer Support für DACH mit unterschiedlichen Formulierungsvarianten

Beide Modelle sind moderne LLMs und beherrschen Mehrsprachigkeit auf gutem Niveau. Da o3-mini neuer ist und von OpenAI als bevorzugte Option genannt wird, ist ein pragmatischer Ansatz für „stabilere Qualität“:

- 10–20 reale deutsche Beispiel-Tasks definieren (Support, legal-lite, technische Doku)

- A/B-Test zwischen o1-mini und o3-mini

- Nach Kriterien entscheiden: Intent-Trefferquote, weniger Halluzinationen, stabileres Output-Format

| Situation | o1-mini | o3-mini |

|---|---|---|

| Du nutzt o1-mini stabil, Pipeline läuft gut, du willst noch nicht sofort umstellen | Übergangsweise möglich | Umstieg testen und planen |

| Du willst ein „neueres“ Modell mit maximalem Reasoning bei gleicher Kosten und Latenzklasse | Nicht priorisiert | Von OpenAI empfohlen höhere Intelligenz bei gleicher Latenz und Preis |

| Haupt Use Case STEM Coding mehrstufige Logik | Gut geeignet | Häufig neue Default Wahl |

| Du brauchst Structured Outputs Tool Calling Batch für Production Workflows | Möglich plattformabhängig | Stark für technische Workflows |

| Neues Projekt schnelle Entscheidung welches Modell jetzt | Eher nicht | Zuerst o3 mini wählen dann effort nach Schwierigkeit optimieren |

o3 mini Use Cases

Hier muss Ihr Content “Information Gain” liefern. Viele Top 10 Seiten bleiben allgemein. Sie gewinnen, wenn Sie konkrete Szenarien zeigen.

Coding

- Debugging mit Kontext: Fehlerbeschreibung plus relevante Codeausschnitte, dann “Ursache Hypothesen” und “Fix Vorschlaege” als strukturierte Liste.

- Refactoring Plan: Modul fuer Modul, inkl Risiken und Tests.

- Test Generierung: Unit Tests nach Schema (Arrange Act Assert) und Edge Cases.

- Code Review Checkliste: Security, Performance, Readability, Dependencies.

Keyword Mapping natuerlich einbauen: o3 mini fuer Entwickler, o3 mini Coding, Function Calling, Structured Outputs.

STEM

- Mathe und Logik: Schrittweise Herleitung, dann Kurzfassung, dann Plausibilitaetscheck.

- Algorithmik: Komplexitaetsanalyse, Alternativen, Trade offs.

- Datenanalyse: Hypothesen, Features, Moegliche Bias Quellen, Next Steps.

Workflows und Agenten

- Tool Orchestrierung: Modell entscheidet, wann es Daten aus einer DB holen muss und wann es antworten kann.

- Structured Reporting: Ausgabe als JSON fuer Dashboarding oder Ticket Systeme.

- Batch Verarbeitung: Klassifikation oder Extraktion in grosser Menge (z B Support Tickets, Produktfeedback).

Das ist besonders relevant fuer deutsche Unternehmen, die Effizienz und Nachvollziehbarkeit brauchen: strukturierte Outputs plus Tool Calls reduzieren manuelle Nacharbeit.

Haeufig gestellte Fragen zu O3 mini

1. Ist o3 mini in ChatGPT und in der API verfuegbar?

Ja, OpenAI nennt o3 mini als verfuegbar in ChatGPT und in der API.

2. Unterstuetzt o3 mini Structured Outputs und Function Calling?

Ja, beides wird in den Modelldaten fuer o3 mini aufgefuehrt, ebenso die Batch API.

3. o3 mini oder GPT 4o fuer den Alltag?

Fuer Alltagsaufgaben und Multimodalitaet ist GPT 4o oft stark. Fuer kosteneffizientes Reasoning in Coding und STEM ist o3 mini oft die bessere Wahl.

4. Wofuer ist o3 mini am besten geeignet?

Vor allem fuer STEM, Coding und logiklastige Aufgaben sowie strukturierte Workflows mit Tool Nutzung

OpenAI o3-mini ist ein kleines Reasoning Modell fuer Coding, STEM und logiklastige Aufgaben. Mit Structured Outputs, Function Calling und Batch API eignet es sich fuer effiziente Workflows mit klarer Struktur und guter Kostenkontrolle. Testen Sie es am besten an einem echten Use Case und passen Sie den Argumentationsaufwand an Ihre Ziele an.